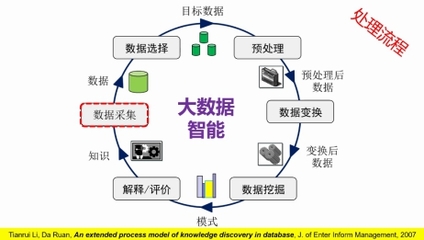

在当今数据驱动的时代,数据处理是信息提取、分析和决策制定的基石。这一过程往往伴随着诸多挑战,如数据质量低下、处理效率不足、工具选择困难等。本文将探讨数据处理过程中的常见问题,并提供一系列行之有效的解决办法。

一、 数据质量问题及解决办法

数据质量是分析结果可靠性的前提。常见问题包括数据缺失、数据不一致、数据重复和异常值。

- 数据缺失:对于少量缺失,可使用均值、中位数或众数进行填充;对于分类变量,可建立预测模型进行填补;若缺失比例过高,需评估是否保留该字段。

- 数据不一致:建立统一的数据标准和清洗规则,如日期格式标准化、单位统一、命名规范等,并利用脚本或ETL工具自动化执行。

- 数据重复:使用去重算法(如基于关键字段匹配)识别并合并或删除重复记录。

- 异常值:通过统计方法(如3σ原则)或可视化方法识别异常值,并根据业务逻辑判断是修正、保留还是剔除。

二、 处理效率与性能优化

面对海量数据,处理速度至关重要。

- 增量处理:避免全量重跑,只处理新增或变更的数据。

- 并行与分布式计算:利用Hadoop、Spark等框架,将任务拆分到多个节点并行执行。

- 算法与查询优化:选择时间复杂度更低的算法;对数据库查询建立索引,优化SQL语句。

- 资源管理:合理分配计算和存储资源,使用内存计算或缓存中间结果以减少I/O开销。

三、 工具与流程的合理选择

合适的工具能事半功倍。

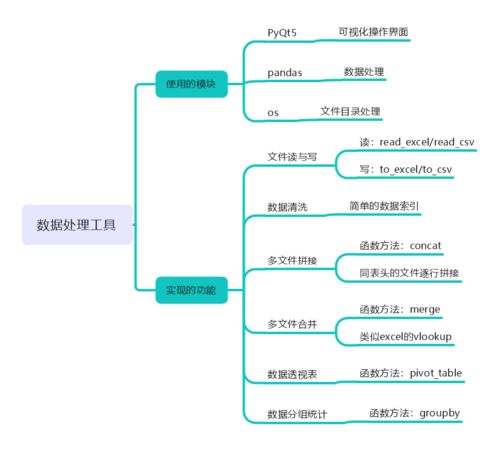

- 明确需求:根据数据量、处理复杂度、团队技能和预算选择工具,轻量级任务可用Python(Pandas)、R,大数据场景则需专业平台。

- 构建标准化流程:建立从数据接入、清洗、转换到加载(ETL/ELT)的标准化流水线,提高可维护性和可重复性。

- 版本控制与文档化:对数据处理代码和流程使用Git等工具进行版本管理,并详细记录数据血缘和转换逻辑,确保过程可追溯。

四、 安全与合规性保障

处理数据时必须考虑隐私和安全。

- 数据脱敏与加密:对敏感信息(如身份证号、手机号)进行脱敏或加密处理,尤其在测试和开发环境。

- 权限管控:实施严格的基于角色的访问控制(RBAC),确保只有授权人员能接触特定数据。

- 遵守法规:确保数据处理流程符合GDPR、个人信息保护法等法律法规的要求。

五、 团队协作与知识管理

数据处理常是团队协作的结果。

- 代码复用与模块化:将常用清洗、转换函数模块化,建立团队共享的工具库。

- 持续监控与预警:对数据处理作业的成功率、运行时长、数据质量指标进行监控,设置异常预警。

- 培养数据素养:提升团队成员的数据处理能力和质量意识,形成规范的操作习惯。

高效的数据处理并非一蹴而就,它需要一个结合了清晰策略、合适工具、严谨流程和团队协作的系统性方法。通过预见性地应对质量、效率、工具和安全等方面的挑战,并实施上述解决办法,组织可以构建出稳健、可靠且可扩展的数据处理能力,从而为深度分析和价值挖掘奠定坚实的基础。