随着云计算、人工智能和大数据应用的爆炸式增长,数据中心正面临着前所未有的数据处理压力。传统的以CPU为中心的架构在处理海量网络数据、存储I/O和复杂的安全协议时,逐渐显露出性能瓶颈和效率不足。在此背景下,数据处理单元(Data Processing Unit, DPU) 应运而生,并迅速成为现代数据中心不可或缺的核心组件。

一、传统架构的瓶颈:CPU不堪重负

在传统的数据中心架构中,CPU承担了绝大部分的计算任务,包括应用计算、网络数据包处理、存储虚拟化、安全加密以及系统管理等。随着网络速度从10GbE、25GbE向100GbE甚至400GbE迈进,以及NVMe存储的普及,这些“基础设施任务”消耗的CPU核心周期越来越多。研究表明,在一个高性能的云服务器中,高达30%甚至更多的CPU资源被用于运行网络、存储和安全堆栈,而非用户的核心业务应用。这导致了巨大的资源浪费和总拥有成本(TCO)的上升。

二、DPU的定义与核心能力

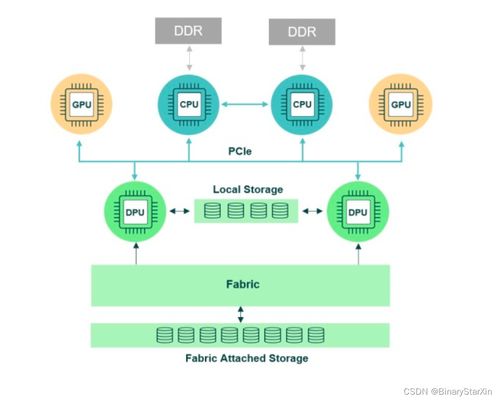

DPU是一种专为数据中心基础设施任务设计的片上系统(SoC)。它通常集成了三个关键部分:

- 高性能多核处理器:通常基于Arm架构,用于运行控制面和数据面软件。

- 高性能网络接口:支持高带宽、低延迟的RDMA(远程直接内存访问)和智能网络卸载。

- 灵活的加速引擎:通过硬件或可编程逻辑(如FPGA)对存储、安全、虚拟化等任务进行硬件加速。

其核心思想是 “基础设施卸载与加速” ,将CPU从繁重的底层任务中解放出来,使其专注于运行商业应用和业务逻辑。

三、数据中心需要DPU的五大核心原因

1. 提升整体性能与效率

DPU通过硬件卸载网络协议栈(如TCP/IP)、存储虚拟化(如NVMe-oF)和加密解密(如TLS/IPsec)等任务,能大幅降低处理延迟并提高吞吐量。CPU得以将全部算力用于产生直接价值的应用计算,从而提升了整个服务器乃至数据中心的效率。

2. 降低总拥有成本(TCO)

从经济角度看,CPU核心是非常昂贵的计算资源。将基础设施任务卸载到更具能效比的DPU上,意味着可以用更少的CPU服务器完成相同的工作负载,或者在相同数量的服务器上支持更多的虚拟机或容器。这直接降低了硬件采购成本和数据中心的空间、电力消耗。

3. 增强安全性与隔离性

DPU可以作为数据中心内部的“可信根”和安全网关。它能够在硬件层面实现安全启动、信任根、密钥管理以及防火墙功能。更重要的是,DPU可以在物理硬件和上层虚拟机/容器之间建立一个强大的、由硬件强化的安全隔离层(“零信任”架构的关键),即使宿主机被攻破,也能保护网络和存储数据的安全。

4. 实现真正的“可组合式基础设施”

现代数据中心正朝着云原生和可组合架构演进。DPU是实现这一愿景的基石。它能够对服务器底层的计算、存储和网络资源进行抽象、池化和灵活调配。通过DPU,管理员可以像分配软件一样动态地分配硬件资源,为每个应用提供定制化的硬件服务级别协议(SLA),极大地提升了资源利用率和运维敏捷性。

5. 应对云原生与微服务的挑战

微服务架构带来了密集的东西向网络流量(服务间通信)。DPU能够智能地处理这种流量,实现服务网格的硬件加速(如服务发现、负载均衡、加密通信),大幅减轻服务网格代理对CPU的消耗,使微服务应用运行得更快、更高效。

四、应用场景示例

- 超融合基础设施(HCI):DPU卸载存储和网络虚拟化,释放CPU资源,使HCI集群在提供相同性能时所需节点数更少。

- 公有云与裸金属服务:云服务商通过DPU提供高性能、安全的网络和存储服务,同时确保多租户之间的强隔离。

- 人工智能/机器学习训练:在分布式AI训练中,DPU可以加速GPU服务器之间的高速通信(如NVIDIA的GPUDirect RDMA),减少数据交换瓶颈。

- 5G边缘计算:在空间和功耗受限的边缘数据中心,高集成度、低功耗的DPU是实现网络功能虚拟化(NFV)和边缘应用高效运行的关键。

###

DPU的出现并非要取代CPU或GPU,而是与它们协同工作,共同构成数据中心计算的“铁三角”(CPU-通用计算,GPU-加速计算,DPU-基础设施处理)。它标志着数据中心架构从“以计算为中心”向“以数据为中心”的深刻转变。通过将基础设施任务专业化、硬件化,DPU正在成为释放CPU潜力、提升数据中心整体效能、保障安全与实现敏捷创新的核心引擎。对于任何追求高性能、高效率和现代化架构的数据中心而言,集成DPU已从一种前瞻性选择,转变为一种必然趋势。